Le cinéma en tant que culture populaire est un excellent moyen de communiquer des idées.

Pour parler de nouvelles interfaces, il m’a souvent été plus simple d’évoquer « Minority Report » et la séquence où Tom Cruise manipule des images plus ou moins holographiques, que d’en expliquer verbalement les principes.

L’interface gestuelle de Minority Report

Ce n’est pas la première fois qu’une œuvre de fiction préfigure de nouveaux usages liés à la technologie – comment ne pas citer Jules Vernes. Mais dans ce cas précis, il y a la force de l’image cinématographique du blockbuster, associée à une certaine crédibilité basée sur des recherches bien réelles du MIT (John Underkoffler). Au final, même près de 16 ans après la sortie du film, l’interface gestuelle n’est pas encore une réalité industrielle. Des dizaines de périphériques et technologies s’y attellent, y compris avec le concours du machine learning pour la reconnaissance efficace des postures gestuelles. Mais, aujourd’hui, personne ne peut prétendre en faire un usage intensif et concret. Ces images, véhiculées par le cinéma, stimulent la créativité en préfigurant un futur crédible mais le rendent parfois trop tangible, éloigné de leur niveau de maturité. Dans le même ordre d’idée, la course à l’innovation et à la « disruption » conduit les sociétés technologiques à une surenchère de mise en scène. Dans la volonté d’exposer une supériorité technologique et une image innovante, les marques technologiques scénarisent l’usage des périphériques VR/AR dans différents contextes métiers. Et là aussi, il y a un syndrome « Minority Report » : les films « démonstratifs » créent un niveau d’attente qui n’est pas atteignable dans le présent. Le summum de l’ambiguïté ayant été atteint avec la vidéo de baleine des lunettes de réalité augmentée Magic Leap. La vidéo datant de 2015 a récemment ressurgi sur les réseaux sociaux professionnels, laissant croire à l’existence d’hologrammes incroyablement réalistes, sans lunettes.

Quel rapport avec des lunettes de réalité augmentée ?

Bien sûr, nous sommes tous impressionnés à juste titre par les lunettes de réalité augmentée de type Hololens : l’ancrage de l’objet virtuel dans la réalité est bluffant, les prémices de l’interface gestuelle prometteurs. Mais les vidéos d’expériences utilisateur de Microsoft ne montrent pas les limitations du champ de vision, les frustrations et la fatigue musculaire induite par l’interaction gestuelle. D’un point de vue technologique, pour pouvoir s’inscrire dans une utilisation industrielle fréquente, ce type de périphérique nécessite des objets 3D très optimisés (on peut dire retravaillés ou créés ad hoc) qui ne sortent pas directement du bureau d’étude et de CATIA. Microsoft a par exemple acheté la société Simplygon pour aider les utilisateurs à préparer leurs données. Concernant la juxtaposition du réel et du virtuel, elle reste possible via un calibrage manuel ou la détection de formes simples à savoir des surfaces planes caractéristiques, mais les algorithmes ne reconnaîtront pas un objet complexe comme un hélicoptère pour y ajouter des objets virtuels. Le recours aux algorithmes d’intelligence artificielle pour améliorer ce croisement du réel et du virtuel via la reconnaissance d’image est un sujet d’actualité, et la prochaine génération des lunettes Hololens sera équipée d’une puce d’intelligence artificielle. L’objet de cet article n’est absolument pas de dénigrer ces nouvelles technologies très souvent impressionnantes, mais de constater le fossé qui sépare parfois la réalité de la perception qu’en ont les non-spécialistes. Dans ce cas, les concepteurs d’applications sont contraints d’effectuer un travail de « reality check » avec des clients qui partent d’un niveau d’efficience fantasmé. C’est aussi la barrière physique qu’il faut franchir : la réalité de l’expérience utilisateur se heurte à des effets physiologiques non négligeables. Le plus connu actuellement est la cinétose (mal de mer), que chacun de nous a ressenti dans des expériences immersives, souvent causée par une ergonomie totalement inadaptée aux contraintes proprioceptives de la réalité virtuelle. Moins connu mais bien réel est le conflit entre l’accommodation et la vergence, lui aussi créateur d’un inconfort visuel et de nausée. Sans parler de la proximité de la lumière bleue, très proche des yeux dans le contexte du casque. Pour retourner dans le monde cinématographique, un autre exemple est celui de Jarvis, l’intelligence artificielle inventée par Tony Stark, qui assiste Iron Man. Elle symbolise un concept un peu plus flou mais séduisant d’omniscience temps réel via une information en réalité augmentée (ou plutôt visée haute). Encore une fois, c’est un concept très efficace en termes de vulgarisation : les concepts sont là et bien visibles. Mais il nous montre aussi une interface invivable. Une métaphore de la surcharge d’information que nous vivons tous aujourd’hui avec nos smartphones et le déficit de concentration inhérent. Mais ici Tony Stark ne peut visiblement pas échapper à ce déluge. Non, s’exposer à trop d’informations ne permet pas d’effectuer une tâche de façon plus efficace.

Jarvis ou la surcharge d’information

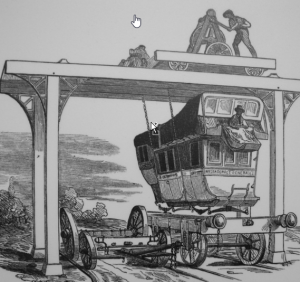

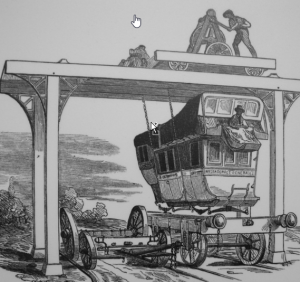

En plus de cette vision de l’avenir et de la super efficience qu’apporteront les technologies d’immersion, la fascination est aussi assez viscérale. L’immersion permet de vivre une expérience qu’il est difficile de décrire tellement elle est prenante. En s’adressant aussi au cerveau limbique et pas seulement au cortex préfrontal, la réalité virtuelle fait naître des émotions aussi vraies que nature. Et c’est unique, l’expérience devient émotive, multi- sensorielle et marquante (pour approfondir, lire le cerveau magicien de Roland Jouvent) Mais la notion d’interaction et d’ergonomie en réalité virtuelle est encore un champ exploratoire. La métaphore présente dans certaines applications « classiques » a-t-elle le même impact en réalité virtuelle, qui lui préfèrera les schèmes (copie de situations réelles). Le risque dans l’adoption de ces technologies, c’est aussi la rupture d’usage trop violente et conceptuelle. Ces innovations ont besoin d’évoluer de façon progressive. La rupture cognitive ne peut être trop brutale, sinon l’innovation n’est pas socialement acceptée. Ce principe a été très bien décrit dans l’effet diligence, défini par Jacques Perriault : les premiers wagons conservaient les attributs de leurs ancêtres : les diligences. Passage transitoire obligatoire vers nos wagons moderne.

Les premiers wagons

Il est donc également naturel de voir des tentatives cinématographiques de représentation de l’interaction qui vont permettre de faire émerger des modèles plus immersifs, conjointement avec les différentes avancées technologiques. Dans le monde industriel et bien réel de notre présent, il est aussi prudent de séparer le fantasme futuriste de la réalité pragmatique.